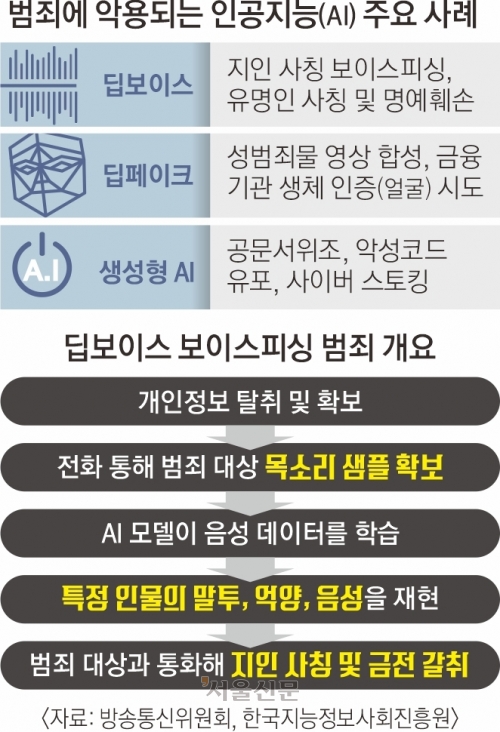

전화 걸어 목소리 수집 후 AI 합성

30초도 안돼 말투·속도 완벽 구현

딥페이크로 금융사 생체인증 시도

“AI 범죄 규모 파악·대응법 찾아야”

“아빠 지금 5000만원만 빨리 입금해 줄 수 있을까? 지금 이 계좌로 좀 보내줘. 나중에 설명할게.”

울먹이며 읍소하는 목소리는 대학교수 A씨가 30년간 들었던 외동딸의 진짜 목소리였다. 돈을 보내려던 A씨는 혹시나 하는 마음에 다시 딸에게 전화를 걸었다. 그러자 “아, 보이스피싱인가봐”라는 답이 돌아왔다. 휴대전화 속 목소리는 인공지능(AI) 기술로 딸의 목소리를 흉내 낸 것이었다.

AI 기술이 발전하면서 이를 악용한 범죄가 진화하고 있다. 과거 보이스피싱이 지인의 목소리를 어설프게 흉내내거나 공공기관을 사칭하는 방식이었다면, 이제는 실제 목소리 정보를 AI로 합성해 조작한다. 이른바 ‘딥보이스’는 먼저 목소리 정보를 얻어낼 상대방에게 전화를 걸어 짧게 통화하는 것으로 시작된다. 이 목소리 데이터를 AI프로그램에 합성하면 가족이나 지인의 음성을 유사하게 만들어 낼 수 있다.

실제 서울신문이 한 딥보이스 앱에 목소리 녹음 파일을 올리자 30초도 채 안 돼 패턴과 속도 등을 분석했다. 이후 “엄마 핸드폰이 고장 나서 그런데 100만원 입금해줘”라는 문장을 글로 입력하고, 상황 등을 설정하자 녹음파일의 목소리와 비슷한 음성이 흘러나왔다. 법무법인 청의 곽준호 변호사는 “목소리 녹음 파일만 있으면 누구나 쉽게 AI로 그럴듯하게 목소리를 만들어 내 범죄에 악용할 수 있다”고 했다. 경찰 관계자도 “목소리를 수집하는 역할을 하는 ‘콜센터’를 검거하기가 쉽지 않다”면서 “이런 유형의 보이스피싱이 빈번해지고 있다”고 전했다.

경찰청에 따르면 지난해 보이스피싱 피해액은 8545억원으로 1년 전보다 91% 늘었다. 하지만 최신 기술인 딥보이스가 악용된 경우가 얼마나 되는지는 공식 통계조차 잡히지 않는다.

-생략

https://n.news.naver.com/mnews/article/081/0003532227?sid=102