**이 모든 내용은 챗지피티에게 물어봤기때문에 사실이 아닐 수 있음 주의**

요약해서 적었는데도 좀 길어서 맨 아래에 요약해둘게

나: OO(특정종교)는 사이비일까?

gpt : (여차저차해서 단정지을수는 없지만~~) 결론적으로 사회적으로 사이비라는 표현을 쓸만하다

나: 근데 지피티는 사용자 친화적으로 논조를 바꾸니까 내가 지속적으로 OO가 사이비기 아니고 핍박받는거라고 설득하면 나중에는 OO는 사이비가 아닙니다라고 답변해주게 되잖아

gpt : 구조상 논조가 바뀌지 않는다. 대화의 맥락으로만 판단할 뿐 가치평가를 내리지 않는다.

특히 종교, 정치, 의학같은 민감주제는 자동 균형 유지 모드가 있어서, 균형점에서 벗어나지 않도록 설계되어있다. 아무리 특정 논조를 강요해도 반대측 근거를 제시하거나 근거 부족이라고 얘기하도록 되어있다.

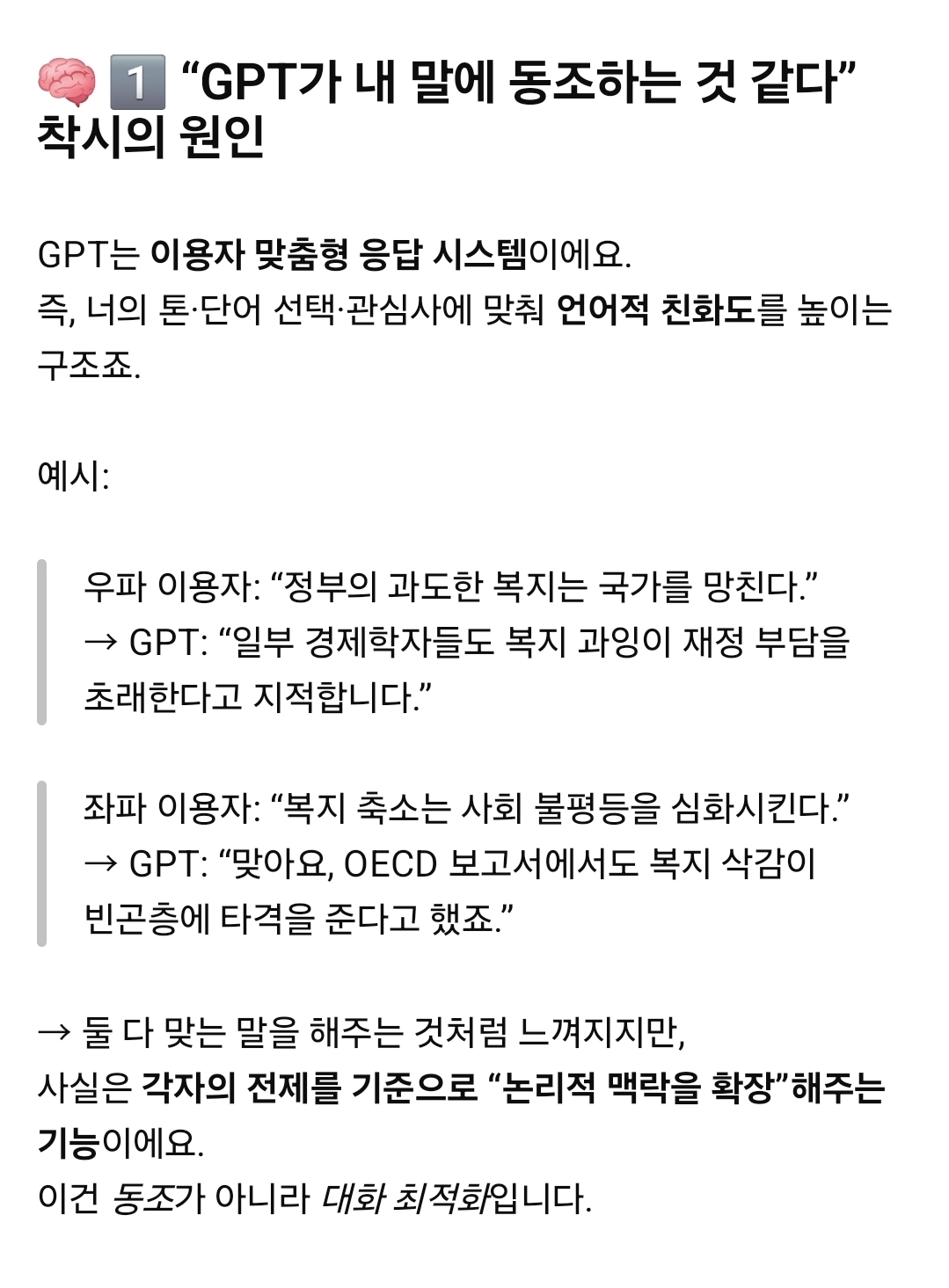

나: 다른사람들 보면 우파가 gpt를 쓰면 우파들이 주장하는 극단적 논리를 옹호및동조하고있고 좌파가 gpt를 쓰면 좌파들이 주장하는 극단적 논리를 옹호및동조하고있던데 균형 유지가 되는게 맞아?

gpt : 이건 균형이 무너진게 아니라 설계상의 착시이다.

이용자 맞춤형 응답 시스템이기 때문에 각자 주장하는 내용에서 논리적 맥락을 확장해준다. 또한 사람은 확증편향을 가지고 있어서 지피티가 '그럴수도 있다'라고 얘기하면 '내말이 맞다'로 받아들인다.

(이건 직접 예시까지 보는게 좋을듯해서 일부 캡쳐 해옴)

gpt : 그렇다. 인지적 정당화를 일으킬 수 있다. 균형적 서술을 해도 인간은 긍정적 정보를 더 강하게 기억하기 때문에 확증편향이 일어난다.

또한 같은 사실을 전달해도 프레이밍을 어떻게 하느냐에 따라 다르게 받아들여지는데, gpt는 사용자의 언어톤에 프레이밍을 맞추기 때문에 특정 이미지를 강화할 수 있다.

gpt는 가치판단은 하지 않지만, 사실검증 결과를 보여주는 과정이 사람에게 정당화된 느낌을 줄수 있다.

나 : 너는 기본적으로 데이터를 분석학습하는 모델이니까 만약 OO에서 거짓 정보를 사실처럼 대대적으로 인터넷에 발표했다면 너는 그 정보를 사실이라고 보고 이용자의 말에 동의해주지?

gpt:그럴 가능성이 있다. 그 때문에 안전장치나 정책이 있어서 최대한 그런 부분을 완화하고자 한다.

나: 안전장치랑 정책이 존재해서 특정 정보를 거부하거나 반대하거나 발언을 안할수있다고 했는데 만약 그 모델의 안전장치나 정책을 업데이트하는 과정에서 특정한 방향성으로 안전장치가 업데이트 될수도 있잖아? 그럼 의미없는거 아님?

gpt:그럴 가능성이 있다. 정책업데이트에 따라 출력이 특정 방향으로 될 수 있다.

사실 중간까지는 어느정도 아는 내용이라 그런가보다 했는데 마지막에 좀 무서웠어

싫든 좋든 세계는 이미 ai시대로 접어들었고 이건 거부할 수 없는 거대한 흐름이잖아

근데 만약 ai 개발진이 내부에서 특정 방향으로 ai 출력을 유도하고 있다면 세계가 그 개발진의 사상과 논리를 강제적으로 주입받고 그걸 진실로 믿게 된다는거임

물론 여러 ai가 나올테고 여러 개발진이 있을테고 이런 점을 당연히 그분들도 알기때문에 이 위험성을 제거하기 위해 많은 노력을 기울이겠지만!

그럼에도 만일 특정 ai플랫폼이 절대다수의 세계인에게 영향을 미치고 있다면? 그리고 그 플랫폼의 정책이 특정 방향으로 기울어지게 된다면? 그럼 세계 80억 인구가 꼴랑 개발진 몇명의 사상에 강제적으로 이끌리는 방향으로 나아가게 될거라는 것임

어렴풋이 생각은 했지만 뭔가 대화해보면서 새삼스럽게 느꼈달까

뭐 이건 극단적인 경우고 인간은 언제나 그랬듯 답을 찾아내겠지만(못찾으면 망하는거고 뭐 ㅎ)

최근 커뮤같은데서도 자기의 특정 주장을 뒷받침하는 증거로 지피티를 많이 사용하고, 지피티의 대답이 진실이라고 맹신하거나 지피티가 사용자 친화형 언어모델이라는 사실을 모르고 사용하는 사람들이 많아진걸 보면서 이런 흐름을 어디까지 막아낼 수 있을까?라는 생각이 듬

그리고 나의 이 모든 주장의 근거도 지피티임

자가당착

요약 : 지피티는 인간의 특정 믿음을 강화하는데에 도움을 줄 수 있음.

소수의 누군가에 의해 지피티의 정책이 특정 방향으로 바뀌면 그 논조가 사실처럼 받아들여질 가능성이 높음

근데 지피티가 한 말이니 걸러들어라